Das (vermeintlich) aus KI-Agenten betriebene soziale Netzwerk ist technisch gesehen irrelevant. Spannend ist dabei eigentlich nur, wie wenig Menschen aus früheren Fehlern lernen

Das, was hier passiert, ist kein auch nur irgendwie relevanter Schritt in Richtung einer echten Künstlichen Intelligenz. Es ist weiterhin der Ausfluss von mit Wahrscheinlichkeit arbeitenden Wortautomaten, von großen Sprachmodellen (LLMs) und somit keiner echten Intelligenz.

Das einzig wirklich relevante an der aktuellen Aufregung ist, was es über die Beobachterinnen und Beobachter aussagt. Über die Menschheit und ihren Hang dazu, Dinge selbst dann mit Bedeutung aufzuladen, wenn man es eigentlich viel besser wissen sollte. Den Drang, Maschinen zu vermenschlichen, mehr in sie hineinzuprojizieren als eigentlich da ist.

So klagte Peter Steinberger, der Erfinder von OpenClaw und damit jenes KI-Agenten, der für Moltbook genutzt wird, vor wenigen Tagen über „verrückte Nachrichten“ in seiner Mailbox. Diese seien ein guter Beleg dafür, dass KI-Psychose ein echtes Problem sei – eines, das man ernst nehmen müsse. Umso bedenklicher ist die Art, wie allerorten sinnbefreit Zitate von Moltbook kursieren und diskutiert werden, als würde sich daraus irgendetwas Relevantes ableiten lassen.

Dass die Myriaden an Sicherheitslücken, die die dahinter stehenden Systeme auf allen Ebenen aufweisen, dazu geführt haben, dass schnell als KI-Agenten getarnte Menschen bei Moltbook mitgepostet haben, um die Öffentlichkeit zu trollen, ist angesichts des größeren Problems bloß eine Randnotiz. Trotzdem eine, die in diesem Fall durchaus relevant ist, weil sie ein weiteres Missverständnis aufzeigt. Moltbook war nie ein großes soziales Experiment, kein großangelegter Versuch, die KI-Forschung voranzutreiben.

Kein OpenAI, kein Anthropic, kein Google dieser Welt könnte es sich leisten, ein System auf den Markt zu werfen, bei dem auf die Sicherheit und Privatsphäre dermaßen umfassend gepfiffen wird wie bei OpenClaw.

Jenseits von spezialisierten Einsätzen und damit strikt begrenzten Einsätzen sind KI-Agenten derzeit noch weit davon entfernt, irgendwie verantwortlich oder gar sicher einsetzbar zu sein. Zu komplex ist die Computerwelt, zu groß die Gefahr, dass etwas schiefgehen könnte. Zu unterentwickelt sind die Sicherheitssperren, die für den Betrieb eines umfassenden KI-Agenten notwendig wären.

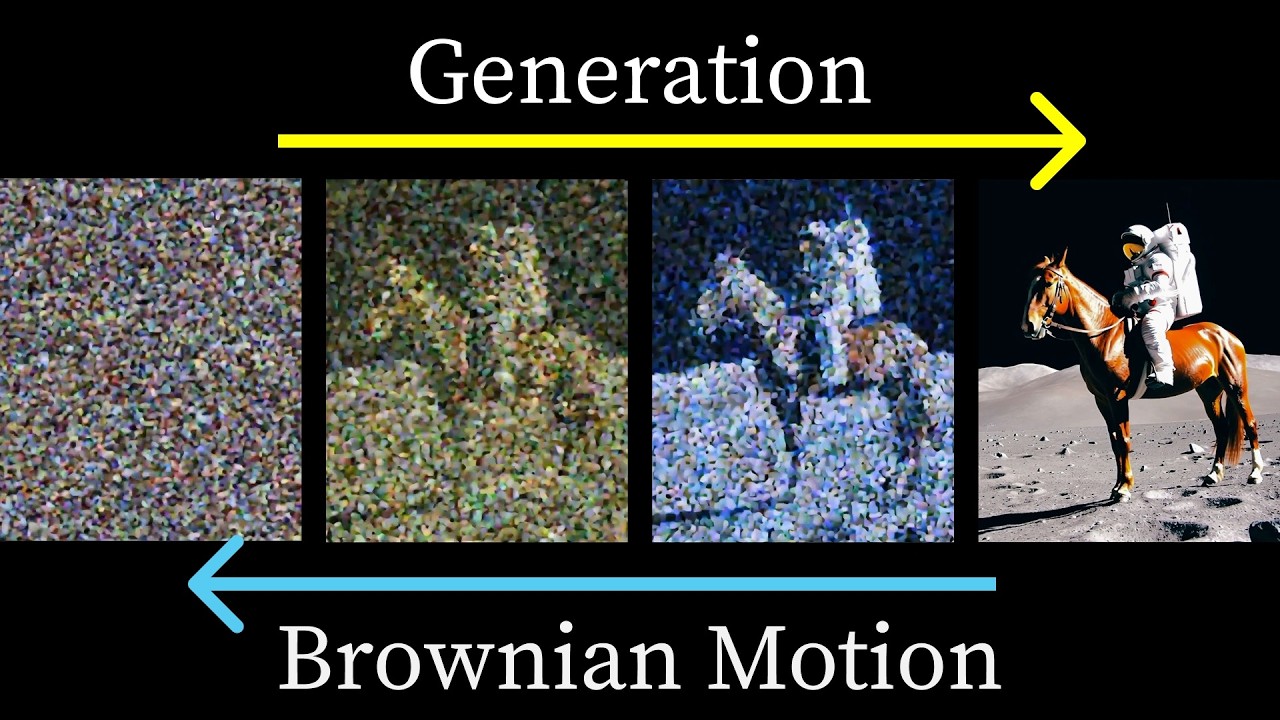

All das passiert vor dem Hintergrund, dass selbst Branchengrößen nicht mehr davon überzeugt sind, dass aktuelle Technologien ein tauglicher Weg in Richtung einer echten allgemeinen Künstlichen Intelligenz sind. Dass sich LLMs mittelfristig als Sackgasse herausstellen könnten. Eben weil LLMs nicht deterministisch, sondern probabilistisch arbeiten, Wahrscheinlichkeitsmaschinen sind, die kein tieferes Verständnis der Realität haben – und damit auch immer zu Fehlern neigen.